AI大模型的推理训练,最渴求的就是强劲的算力,可以来自CPU通用处理器,可以来自GPU加速器,可以来自ML/DL加速器,也可以是多种异构硬件的组合。

当下最火的当然是NVIDIA GPU加速器,但一花独放不是春,能够提供强劲算力硬件方案的厂商很多。

纵观整个AI江湖,唯一拥有全套方案、可真正替代NVIDIA的,只能是Intel:至强处理器、GPU Max、Gaudi加速器多管齐下,再加上强大丰富的开发工具、开放生态的开发平台,要啥有啥,表现还相当不赖。

今年6月,机器学习与人工智能开放产业联盟MLCommons公布了AI性能基准测试MLPerf Training 3.0的结果。

结果显示,Intel四代至强内置的各种加速器,使其成为在通用CPU处理器上运行大量AI工作负载的理想方案,Gaudi2加速器则在生成式AI、LLM大语言模型方面有着优秀的性能。

此外,Intel还提供了经过优化的、易于编程的开放软件,降低AI部署门槛。

8月份,MLCommons又公布了针对60亿参数大语言模型、计算机视觉与自然语言处理模型GPT-J的 MLPerf 3.1基准测试结果,Intel的表现依然值得称道。【粉丝网】

其中在GPT-J模型上,Gaudi2加速器的GPT-J-99、GPT-J-99.9服务器查询和离线样本的推理性能分别为78.58次/秒、84.08 次/秒。

与竞品比较,Gaudi2相对于NVIDIA上一代A100的性能优势可达2.4倍(服务器)、2倍(离线),而最新一代的H100相对于Gaudi2也只有1.09 倍(服务器)、1.28 倍(离线)的微弱优势。

同时,Intel四代至强在视觉、语言处理、语音、音频翻译模型,以及更大的DLRM v2深度学习推荐模型、ChatGPT-J模型上处理通用AI负载时,性能都非常出色。

比如使用GPT-J对大约1000-1500字新闻稿进行100字总结的任务,四代至强在离线模式下每秒完成两段,实时服务器模式下则可完成每秒一段。

此外,Intel还首次提交了至强CPU Max处理器的MLPerf测试结果,其集成最多64GB HBM3高带宽内存,对于GPT-J而言是唯一能够达到99.9%准确度的CPU,非常适合精度要求极高的应用。

还有非常关键的一点:迄今为止,Intel是唯一一个使用行业标准深度学习生态软件并公开提交CPU结果的厂商,Gaudi2是仅有的两个向GPT-3大模型训练基准提交性能结果的解决方案之一。

那么,Intel Gaudi2加速器、至强处理器为何能在AI算力上如此彪悍?Habana Labs中国区总经理于明扬做出了详细解读。

据介绍,MLPerf 3.1推理测试中,Gaudi2和H100一样都采用了FP8精度,GPT-J测试结果非常令人满意,准确率高达99.9%,和H100的差距非常小。

这主要是因为Gaudi2 MME支持FP8、BF16精度加速,而且结构设计合理,可以高效提升推理能力。

同时,Gaudi2也和H100一样使用了HBM高带宽内存,Intel也很好地预测了市场,并预估了额外的需求,因此基本保证了供应和生产,可以满足市场需求,不像NVIDIA那么头疼产能。

至于A100,它并不支持FP8而仅支持FP16,所以Gaudi2比之优势非常明显,这也显示了Gaudi2架构和软件设计的领先性,以及资源利用率的高效性。

非常关键的是,Intel Gaudi2的性价比优势明显,不像A100、H100那样动不动几十万一块,让中小企业和个人开发者望洋兴叹。

Intel也已经开放了开发者云,让不同客户可以访问不同的Intel AI硬件,大大降低AI工作成本。

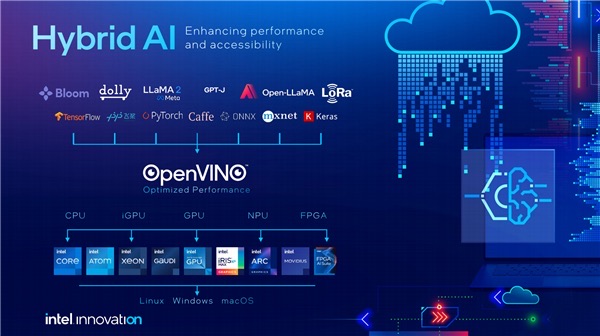

除了硬件性能的比拼,Intel也在软件生态上持续大力投入,虽然暂时还做不到NVIDIA CUDA生态那样有着独一无二的优势,但也有自己的突出特点。

于明扬强调,在软件生态上,Intel一直主张开放,比如通过开发者社区与开发者互动,提供优化后的模型、开源驱动和工具库,并支持Pytorch、Deepspeed等开源框架,加入和维护开放生态,为客户、合作伙伴和开发人员提供早期访问和便捷、迅速的途径。

Intel oneAPI也能提供更为开放的环境,支持不同层面的定制化开发,Intel和客户都可以在软件中添加新的加速算子,并且upstreaming到框架开源社区中。

值得一提的是,在软件上CUDA的影响已经大大缩小,对整体开发和应用环境更加有利。

事实上,NVIDIA目前的强大只是GPU一条腿走路,CPU通用处理器是欠缺的。

虽然NVIDIA也开发了Grace CPU,并打造了所谓的“超级芯片”,可以将两颗Grace CPU或一颗Grace CPU加一颗H100 GPU进行整合,但毕竟是基于Arm架构,性能较弱,而且缺乏通用性。

Intel则凭借多管齐下的多硬件组合,可以构建强大、灵活异构计算平台,从而支持更大的模型规模,满足更广泛的系统需求。

于明扬指出,至强可扩展处理器有着最好的通用性,可以运行各种AI工作负载。

四代至强还衍生出了的至强CPU Max系列,是行业唯一一款具有HBM高带宽内存的x86处理器,无需更改代码,即可加速多种HPC、AI工作负载。

Gaudi系列加速器则专注于机器学习、深度学习的环境,以及未来对大语言模型的需求。

当然还有数据中心GPU Max系列,虽然才刚刚诞生,但是拥有47个功能模块、1000多亿晶体管的它,有着巨大的潜力和广阔的前景,在各种科学负载中相比H100可综合领先30%,还已经用于百亿亿次超级计算机“Aurora”。

这样的丰富组合,别说NVIDIA,在整个行业内都没有可与之匹配的。

面向未来,Intel也自信满满地公布了Gaudi加速器、至强处理器的多年路线图,让人充满期待。

Gaudi 3将把制造工艺从7nm升级到5nm,带来的性能提升堪称一次飞跃:

BF16算力提升4倍,计算性能提升2倍,网络带宽提升1.5倍,HBM高带宽内存容量提升1.5倍。

从示意图上看,Gaudi3的主芯片将从单颗升级为两颗整合,HBM内存则从6颗增加到8颗。

再往后更是革命性的变化:Falcon Shores将是Intel第一次把x86 CPU、Xe GPU双架构融合在一起,官方称之为XPU,类似AMD Instinct MI300A。

按照Intel之前给出的数字,对比当今水平,Falcon Shores的能耗比提升超过5倍,x86计算密度提升超过5倍,内存容量与密度提升超过5倍。

Emerald Rapids五代至强将在12月14日正式发布,这是至强历史上第一次一年内更新两代,增加到最多64核心128线程,同样功耗水平下可提供更高的性能和存储速度。

2024年上半年,至强将首次采用E核能效核设计,代号Sierra Forest,最多达到惊人的288核心288线程,而且首次引入Intel 3制造工艺,预计可使机架密度提升2.5倍、每瓦性能(能效)提高2.4倍。

紧随其后的是同样Intel 3工艺、全部P核性能核设计的Granite Rapids,AI性能对比四代至强预计可提高2-3倍。

2025年,我们将看到代号Clearwater Forest的再下一代至强,纯能效核设计,升级为Intel 18A制造工艺。

按照规划,那个时候,Intel将重新夺回制程工艺的领先地位,对于提高AI硬件的能效大有裨益。

总之,未来在AI计算领域,Intel将会提供更加强大、可满足不同应用场景和TCO成本的AI产品组合,为客户打造统一的开发平台,形成完整的产品生态链。